Lecture 17

•Introduction to Deep Learning Continued..

• Layers in Convolutional Neural Networks (CNN)

• Types of Layers

• Fully Connected (FC), Convolution, Pooling, Softmax…

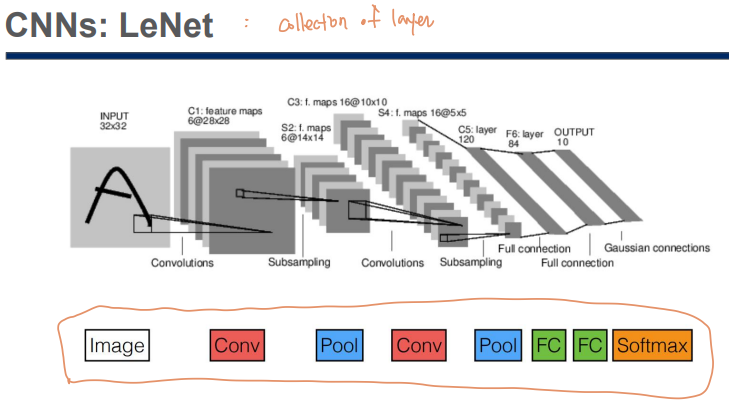

Convolutional Neural Networks (CNN) 합성곱 신경망

나의첫 6장 p.236~257

밑시딥 7장 p.227~260

모두딥 16장 p. 209~240

CNN이란?

CNN 쉽게 이해하기

컨볼루션 신경망은 입력된 이미지에서 다시 한번 특징을 추출하기 위해

커널(=필터, 슬라이딩 윈도)을 도입하는 기법임.(collection of layer)

새롭게 만들어진 층을 컨볼루션(합성곱)이라고 부름.

컨볼루셔널 뉴럴 네트워크는 컴퓨터 비전에서 많이 사용되는 딥러닝 모델임.

CNN은 우리의 뇌가 사물을 구별하듯 생김새(각 사물의 특징) 정보로

사물을 학습(어떠한 특징이 사물을 구별하는 주요 특징인지 알아냄)하고 구별해냄.

고유 이미지의 형변환 없이 그대로 입력 데이터를 처리함. (생김새 정보를 잃지 않음)

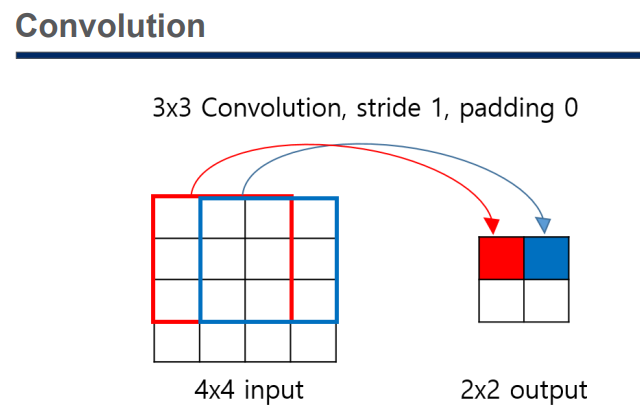

필터(=커널, 특징을 추출하기 위한 네모 상자)를 이동하는 기법(스트라이드=필터를 적용하는 위치의 간격)

-> 필터와 이미지 영역의 겹치는 부분마다 곱셈이 이뤄지고 최종적으로 더해짐.

-> 최종값이 크다면 필터와 겹쳐진 부분이 많다는 의미임.

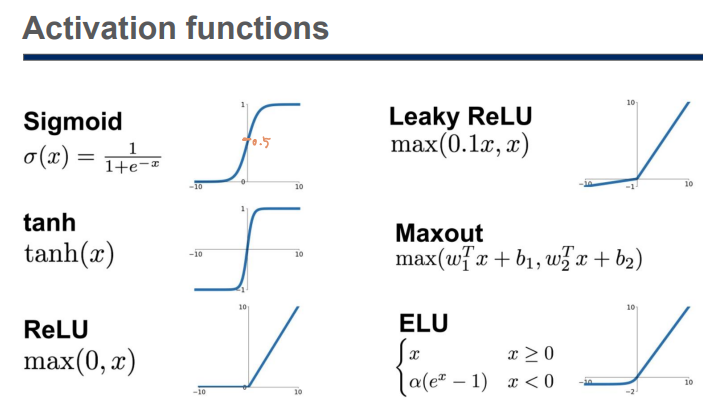

보통 CNN에서는 활성화함수로 ReLU를 많이 사용함.

* 활성화 함수

: 입력 신호의 총합을 출력 신호로 변환하는 함수.

입력 신호의 총합이 활성화를 일으키는지 정하는 역할을 함.

대표적인 CNN

LeNet(손글씨 숫자를 인식하는 네트워크), AlexNet(ReLU이용, LRN계층 이용, 드롭아웃 사용)

AlexNet is the name of a convolutional neural network (CNN) architecture

Layer

= Function

특정 특징을 구분하기 위해 여러개의 필터(커널)가 존재함.

CONV는 필터가 존재하는 컨볼루셔널 레이어(합성곱 계층)를 뜻함.

FC가 여러 개 연결돼 있으면 다층 퍼셉트론이 됨.

POOL의 주된 목적은 모델 파라미터를 줄임으로써 모델의 계산량을 줄이는 데 있음.

파라미터가 줄어드니 과대적합을 조절하는 효과도 기대할 수 있음.

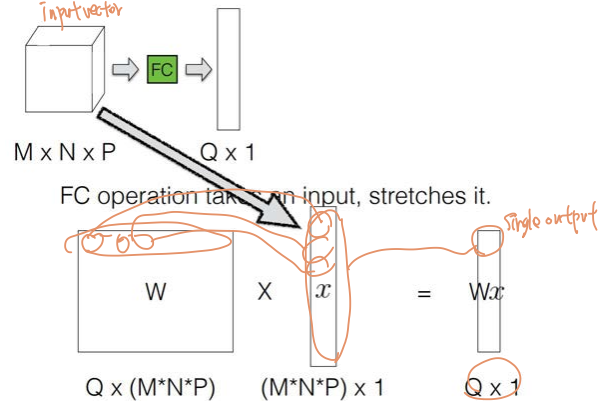

Fully connected layer (FC)

Locally connected layer

Convolutional layer

한 Convolutional Layer는 Convolution처리와 Activation function으로 구성되어 있음.

여러개의 필터(커널)를 사용하여 결과값 얻음.

* 제로 패딩

: 0으로 입력 행렬의 테두리를 감싸는 기술.

-> CONV에 의한 정보 손실 방지 (스트라이드 이후에도 행렬 사이즈 동일하게 유지),

0으로 감싸진 부분이 테두리라는 정보 역시 CNN이 활용할 수 있는 정보임.

Max pooling layer

Shrinks(축소) the feature smaller (compact + manageable).

Pooling은 각 결과값(feature map)의 dimentionality를 축소해 주는 것을 목적

Types of Pooling layers

• Max pooling (most common)

• Average pooling

• L2-norm pooling

Reduces number of parameters in the following layers

Hence, less overfitting!

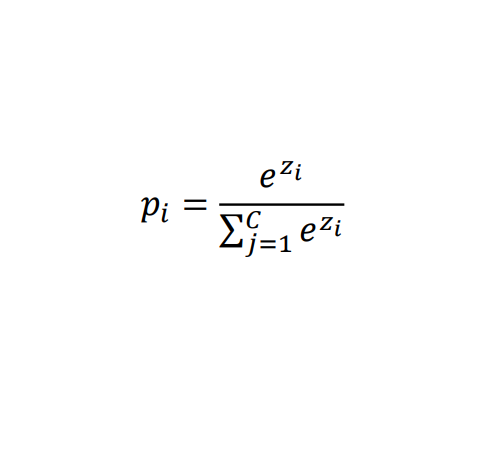

Softmax

Softmax(소프트맥스)는 입력받은 값을 출력으로 0~1사이의 값으로 모두 정규화하며

출력 값들의 총합은 항상 1이 되는 특성을 가진 함수

분류하고 싶은 클래수의 수 만큼 출력으로 구성함.

가장 큰 출력 값을 부여받은 클래스가 확률이 가장 높은 것으로 이용됨.

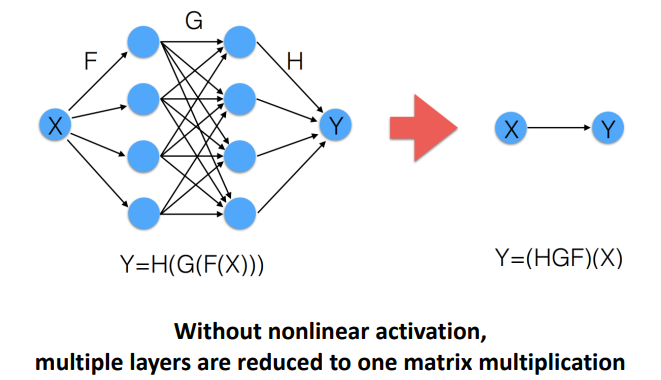

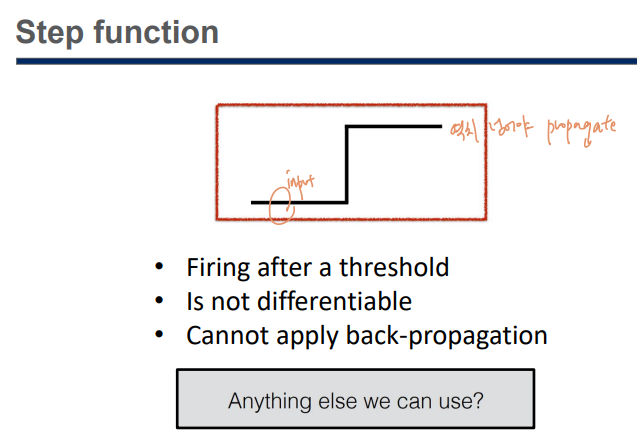

Activation functions

선형함수(linear function)인 convolution에 비선형성(nonlinearity)를 추가하기 위해 사용하는 것

-> 경사 0 문제

-> 해결책! (Leaky ReLU, ELU)

CNN applications

• Image classification

• Object detection

1. Object proposal

2. Evaluate each proposal

• Object segmentation

• Image resolution

• Human pose detection

• Action classification

• Image captioning

'CS > 3-2 딥러닝' 카테고리의 다른 글

| [비디오이미지프로세싱] 14~16. Loss Function & Optimization, Neural Networks & Backpropagation (0) | 2022.10.19 |

|---|---|

| [비디오이미지프로세싱] 11~13. k-means, Principal Component Analysis (0) | 2022.10.19 |

| [비디오이미지프로세싱] 08~10. Support Vector Machine (1) | 2022.10.19 |

| [비디오이미지프로세싱] 05~07. Stochastic Gradient Descent, K-Nearest Neighbors (0) | 2022.10.19 |

| [비디오이미지프로세싱] 03~04. Linear Regression, Gradient Descent (0) | 2022.10.18 |

댓글